FA-SSD:使用上下文和注意力机制的小目标检测

论文主要提出一种基于上下文的目标检测方法和一种基于注意力的目标检测方法,并将两者结合,在小目标检测问题上达到sota

小目标检测相关的工作

文中列举的小目标相关的工作

- 数据扩充,解决小目标数量不足的问题 (减少大目标的大小来扩充小目标数据)

- DSSD,将反卷积应用在SSD的所有特征图上,得到按比例放大的特征图,但因所有特征图用了反卷积模块使得复杂度增加,速度减慢

- R-SSD,通过池化和反卷积结合了不同尺度的特征,获得比DSSD更高的精度和速度

论文提出的方法

文章是基于SSD来改进,提升其检测小目标的能力

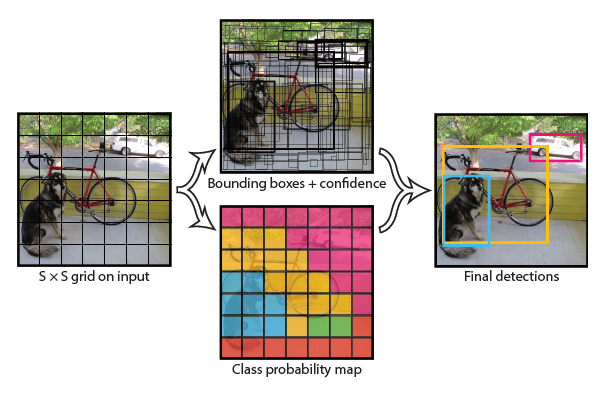

SSD本身以VGG16作为主干网络,创建不同分辨率的特征图,每个特征通过一个额外的卷积层来匹配输出通道,思想主要是利用浅层特征图的高分辨率来检测较小的目标,而利用分辨率较低的深层特征来检测较大的目标

尽管如此,SSD在小目标检测的性能依旧非常低,在VOC2007上小目标的mAP只有20.7%,作者认为主要有两个原因,一是缺乏上下文信息,二是浅层特征缺乏语义信息,所以改进主要针对这两方面

F-SSD:上下文和特征融合

思路非常简单,为了给目标特征提供上下文,将其和更高层次的特征进行融合,模型如下

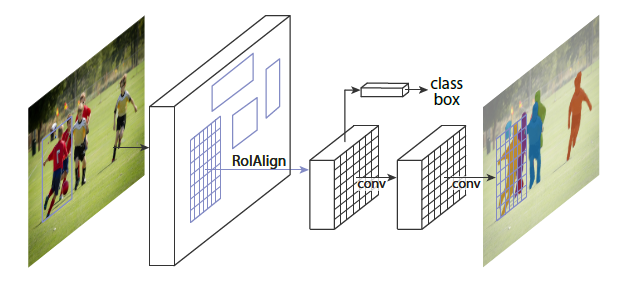

因为特征的映射空间大小不同,所以融合方法如下图,在将特征融合之前,对上下文特征进行反卷积运算,使得其空间大小相同

同时,作者将上下文特征通道设置为目标特征的一半,使得上下文信息量不会压到目标特征本身,文中采取的上下文信息和目标特征的融合方式是直接叠加

A-SSD:添加注意力模块

模型主要是采用了残差注意模块,网络结构如下图所示

残差注意模块和组件内容如下所示

FA-SSD:两种方法融合

模型如下

结果对比如下图

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来自 未央の童话镇!

评论

TwikooValine